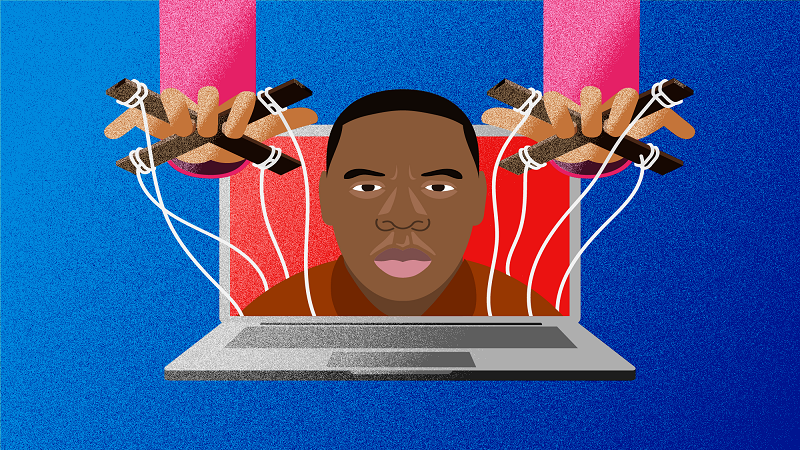

دیپ فیک (DeepFake) یا جعل عمیق، یک فناوری جدید است که بر مبنای هوش مصنوعی می باشد و از طریق آن می توان تصاویر و ویدیو های دروغین و در عین حال واقع گرایانه ساخت. این موضوع تاکنون باعث وحشت خیلی از افراد شده است زیرا نتیجه ی نهایی که از فناوری دیپ فیک به دست می آید چیزی کاملا متفاوت از حقیقت است و میتواند اخلاقیات را زیر سوال ببرد. عملکرد این فناوری از نام آن کاملا پیداست. در رابطه با این فناوری به طور مفصل در مطلبی جداگانه پرداخته ایم. اما اکنون در این مطلب می خواهیم دیپ فیک صوتی را بررسی کنیم. در واقع دیپ فیک صوتی نیز همچون نمونه های تصویری و ویدیویی، از هوش مصنوعی برای تغییر صدای افراد استفاده می کند.

در ویدیو های دیپ فیک شخصیت های غیر واقعی را در یک فیلم قرار می دهند و آن را واقعی جلوه می دهند. بنابراین می توان گفت که با ظهور این فناوری دیگر به چشم های خود و آنچه که میبینیم نیز نمی توان اعتماد کرد. همچنین با وجود دیپ فیک صوتی و نمونه هایی که از آن منتشر شده است نیز نمی توان به آنچه می شنویم هم اعتماد کنیم. این موضوع می تواند خیلی خطر ساز باشد. به عنوان نمونه یکی از دوستان شما ویس یا پیام صوتی برایتان میفرستد و یا اینکه با شما تماس میگیرد و از شما رمز عبور مهم مشترکی را می خواهد تا برایش بخوانید. اما آیا او واقعا دوست شماست و آن صدا، صدای خودش است؟

با اینکه این فناوری (دیپ فیک) در ابتدا صرفا به عنوان سرگرمی ایجاد شد اما رفته رفته برخی از افراد آن را برای مقاصدی همچون سو استفاده گری به کار گرفتند و اکنون دیپ فیک تبدیل به یک نگرانی و بحران امنیتی شده است. به عقیده ی برخی از متخصصان امنیت ممکن است در آینده محتوای دیپ فیک صوتی و تصویری حتی به جنگ های جهانی بیانجامد. به عنوان نمونه اگر از مقام مسئول یک کشور پیامی صوتی یا تصویری پخش شود که در آن اعلام جنگ با کشوری دیگر کند چه حواهد شد؟ ممکن است دیگر کار از کار بگذرد و پیش از پاسخ رسمی مقام مسئول و تکذیب آن محتوای منتشر شده جنگ آغاز شود. در نهایت آشنایی با دیپ فیک اهمیت بالایی دارد و می تواند جلوی فریب خوردن شما را بگیرد و امنیتتان را در برابر کلاهبرداری های این چنینی بگیرد.

دیپ فیک صوتی چیست؟

خیلی وقت ها در فضای مجازی شاهد ویدیو هایی بوده ایم که در آنها چهره ی یک شخصیت اصلی با چهره ی فرد دیگری جا به جا شده است. تشخیص تقلبی بودن یک چهره در نمونه های حرفه ای از دیپ فیک بسیار سخت خواهد بود. اکنون در دیپ فیک صوتی با استفاده از هوش مصنوعی به تغییر و تقلید صدای افراد می پردازند. دیپ فیک صوتی همانند فتوشاپی می باشد که برای صوت به کار رفته است. اغلب اوقات می توان یک فایل فتوشاپ را که نا شیانه است شناسایی کرد اما مردم در شناسایی دیپ فیک صوتی ۵۷ درصد دقت می کنند. فناوری دیپ فیک صوتی مبتنی بر هوش مصنوعی می باشد و از آن برای جا به جایی یا کپی کردن صدای افراد استفاده میکند.

نکته ای که در دیپ فیک صوتی باید به آن توجه داشت این است که اغلب محتوا های ضبط شده از تماس های صوتی یا پیام های صوتی که در شبکه های اجتماعی وجود دارند دارای کیفیت پایینی هستند. همانطور که می دانیم این محتواها در محیط های شلوغ و پر سروصدا و با دستگاه هایی که حرفه ای نیستند ضبط می شوند. حال، در این شرایطی دیپ فیک صوتی می تواند بسیار راحت وارد عمل شود زیرا شناسایی صدای اصلی و تقلبی زمانی که کیفیت صدا پایین تر باشد، سخت تر خواهد بود.

علت به وجود آمدن دیپ فیک صوتی یا صدای جعلی چیست؟

برای صدای تقلبی و مصنوعی به خصوص در دنیای بازی، تقاضای زیادی وجود دارد. قبلا صدای حرف زدن افراد در بازی ها به طور آنی ساخته نمی شد و در بازی های حرفه ای صدای شخصیت ها با صحنه های سینمایی با کیفیت هم به صورت ایستا ضبط و پخش می شد. اما در حال حاضر با پیشرفت چشمگیر و روزانه تکنولوژی، استودیو ها می توانند صدای یک بازیگر را کپی کنند. با به کار گیری فناوری تبدیل متن به صوت می توان صدای زنده فردی را کپی کرد و آن را به شخصیت های بازی داد. در این صورت شخصیت های بازی بهصورت کاملا زنده صحبت می کنند.

از صداهای مصنوعی علاوه بر بازی ها برای تبلیغات و پشتیبانی مشتریان و دیگر حوزه های فناوری هم استفاده می شود. به عنوان نمونه در بخش پشتیبانی و ارتباط با مشتری صدایی طبیعی و مشابه صدای انسان که به پرسش ها واکنشی طبیعی نشان دهد بسیار کارآمد است. همچنین زمانی که استیون هاوکینگ در سال 1985 صدایش را از دست داد، برای صحبت کردن از صدای مصنوعی استفاده می کرد. همانطور که میدانید از هر چیزی می توان به طور مثبت و منفی استفاده کرد، بنابراین نمی توان به طور کامل دید منفی به صدای مصنوعی یا ساختگی و دیپ فیک صوتی داشت زیرا تاکنون کاربرد های بسیار مفیدی نیز داشته است.

دیپ فیک صوتی یا صدای مصنوعی به چه صورت ساخته می شود؟

افراد زیادی طرفدار صدای مصنوعی هستند و شرکت های مختلفی هستند که در این حوزه فعالیت دارند. شرکت های Resemble AI و Descript برای کاربران عادی دمو های آنلاین با امکانات قابل توجهی قرار می دهند. برای اینکه یک نمونه ی کامل از صدای شما ساخته شود باید صدای خود را با خواندن یک متن روی نمایشگر ضبط کنید و سپس ارسال نمایید.

فرآیند تبدیل نمونه ی صدا به صدایی کامل از طریق فناوری هوش مصنوعی و به خصوص الگوریتم های یادگیری عمیق صورت می گیرد. جزئیات صدای شما توسط این الگوریتم ها از نمونه صدای ضبط شده استخراج شده و از آن یک مدل صدا ساخته می شود. اکنون برای تلفظ کلماتی که شما به کار نبرده اید بلوک های سازندهی زبان استخراج می شوند تا از آنها برای این منظور استفاده شود.

برای ساخت الگوریتم های حرفه ای توسط توسعه دهندگان نیاز به مجموعه ای وسیع از صداهای ضبط شده بود تا از فرآیند های ساخت صدا نتایج قابل قبولی به وجود بیاید. برای توسعه ی الگوریتم های بینایی کامپیوتری، دانشمندان به توسعه ی شبکه های GAN پرداختند که این شبکه توانایی پیش بینی بر اساس داده های موجود را داشت. همین امر باعث شد تا پایه های پیشرفت هوش مصنوعی صوتی نیز ایجاد شود.

در فناوری دیپ فیک صوتی یا همان کپی کردن صدا نو آوری مهمی به وجود آمد که باعث شد نیاز به داده های خام را تا حد زیادی برای ساخت یک صدا کاهش دهد. برای ساخت صدای مصنوعی در گذشته به ده ها ساعت صدا نیاز بود اما در حال حاضر تنها با چند دقیقه نمونه ی صدا، میتوان دیپ فیک صوتی ایجاد کرد.

تعهد اخلاقی توسعه دهنده ها

پیشرفت فناوری دیپ فیک صوتی به گونه ای است که باعث می شود ترس و نگرانی ها را در رابطه با ساخت نمونه های بسیار نزدیک به واقعی افزایش دهد.

مسائل و چالش های اخلاقی بسیاری بر سر راه توسعه دهندگان فناوری هوش مصنوعی برای تولید صدا وجود دارد. این اطمینان باید از سوی این توسعه دهندگان به جامعه داده شود که فناوری تولیدی برای کاربرد های سو استفاده گرایانه و غلط استفاده نخواهد شد. توسعه دهنده ها باید قوانین و چارجوب های سختگیرانه ای را برای فروش فناوری ساخت صدای مصنوعی (دیپ فیک صوتی) اعمال کنند.

وب سایت Resemble AI بخشی را مخصوص همین موارد اختصاص داده است. به عنوان نمونه در بخشی از پیش نیاز های اخلاقی این سایت آمده است که شرکت های خریدار فناوری، فرایندی سختگیرانه را طی می کنند تا با مسئولیت پذیری کامل از محصول خریداری شده استفاده شود. همچنین خریداران موظفند تا تاییدیه و اجازهی لازم را از صدا پیشه ی اصلی برای استفاده کردن از صدایش دریافت کنند.

جهت پیشگیری از از سو استفاده از فناوری تغییر صدا راهکارهایی جدی باید در پیش گرفته شود. شرکت های Resemble AI و Descript کاربر را ملزم می کنند تا صدایش را از طریق میکروفن و به حالت زنده وارد کند تا مانع از وارد شدن صدای فرد دیگر و ساخت مدل از روی آن شوند.

خوشبختانه این سیاست ها و قوانین سخت گیرانه در شرکت هایی که فناوری دیپ فیک صوتی را به صورت تجاری عرضه میکنند باعث می شود کمی به آینده ی این فناوری و جلوگیری از سواستفاده های احتمالی امیدوار شویم. از سوی دیگر مشکلی که وجود دارد این است که در دنیای فناوری امروز ابزار های متن باز مشابه و زیادی وجود دارند که می توان از آنها به راحتی و بدون هیچ قانون و تعهد خاصی استفاده کرد. به عقیده برخی از کارشناسان، این الگوریتم ها را می توان بدون دانش برنامه نویسی حرفه ای استفاده کرد.

متخصصان امنیت در رابطه با دیپ فیک صوتی چه می گویند؟

مدت هاست که مجرمان با تماس های تلفنی سعی بر کلاهبرداری و سرقت دارند. و در آن سو متخصصان امنیت همواره دنبال پیدا کردن راهی برای جلوگیری از سرقت ها بوده اند. به عنوان نمونه یکی از شرکت های امنیتی در حوزه شناسایی دیپ فیک های صوتی Pindrop نام دارد که توانست در سال 2019 و با تحلیل 1.2 میلیارد تعامل صوتی مانع از 470 میلیون دلار کلاهبرداری مربوط به کپی کردن صدا شود.

شناسایی کلاهبرداری و دیپ فیک صوتی توسط فناوری های امنیت از طریق ترکیب موقعیت یابی و شناسایی مشخصه های صوتی از تماس ها صورت می گیرد. برای واضح تر شدن این موضوع می توان گفت اگر یک شخص مجرم، با استفاده از تماس های اینترنتی موقعیت مکانی تماس را تغییر دهد و با استفاده از هوش مصنوعی صدا هم کپی شود، می توان آن را از برخی از مشخصه های موجود در مکالمه شناسایی کرد. در اغلب اوقات برخی از مجرمان برای فریب کاری از صدای پس زمینه و شلوغ کردن صدای مکالمه استفاده می کنند. به علاوه ممکن است برخی از افراد جنسیت صدایشان را عوض کنند که این موضوع نیز با کمی دقت قابل تشخیص خواهد بود.

همواره بین متخصصان امنیت سایبری و مجرمان سایبری جدل برقرار است و هر دوی آنها در تلاشند تا فناوری های پیشرفته ای را به دست آورند و جبههی مقابل را شکست دهند. اما متاسفانه فعالیت مجرمان در ترکیب فناوری ها و پیدا کردن قربانی ها بسیار بیشتر است.

چگونه دیپ فیک صوتی را تشخیص دهیم؟

برای شناسایی دیپ فیک صوتی و صداهای جعلی می توان گفت که به یک مقدار مساوی نکات خوب و بد وجود دارد که باید به آنها پرداخت. نکته ی منفی این است که با پیشرفت روزمره ی تکنولوژی این فناوری نیز قوی تر شده و روز به روز سیستم های یادگیری عمیق هوشمند تر خواهند شد و به تولید صدا هایی طبیعی تر می پردازند.

اگر یک فایل صوتی طولانی باشد احتمال شناسایی دیپ فیک بودن آن فایل صوتی بالا می رود و برعکس اگر این فایل صوتی کوتاه باشد شناسایی آن سخت تر است زیرا مخاطب فرصت آمادگی پیدا کردن و دقت کردن به کلیپ را ندارد و در نتیجه امکان فریب خوردن بیشتر خواهد بود.

همچنین زمانی که یک فایل صوتی کیفیت بالایی دارد مشخص شدن جلوه های مصنوعی در آن راحت تر می شود. اما متاسفانه از آنجایی که اغلب تماس های صوتی کیفیت پایینی دارند، شناسایی آنها دشوار می شود.

نکته ی مثبت در رابطه با شناسایی فناوری دیپ فیک صوتی این است که کامپیوتر ها در شناسایی صدای ساختگی از انسانها تواناتر هستند. با پیشرفت ابزار های شناسایی دیپ فیک صوتی خوشبختانه عملکرد تشخیص صدای جعلی در آنها بالا رفته است. به عنوان نمونه شرکت Pindrop از ابزاری استفاده می کند تا تقلبی بودن صدا را با قرار دادن الگوریتم های یادگیری عمیق در نبردی رو به روی هم تشخیص دهد.

برای نمونه صدا های صحبت کردن افراد به طور طبیعی فاصله ی زمانی مشخصی با هم دارند و این به خاطر محدودیت فیزیکی است که در ماهیچه های دهان وجود دارد. بنابراین برای گفتن دو صدای گوناگون باهم، محدودیت سرعتی وجود دارد و شما نمی توانید با سرعت بالایی آنها را به هم وصل کنید. متخصصان امنیتی در این زمینه می توانند تشخیص دهند که صدای مذکور نمی تواند توسط یک انسان عادی تولید شود و برای ادای آن نیاز به گردنی بسیار بزرگ می باشد.

از جمله موارد دیگری که در شناسایی صدای مصنوعی وجود دارد صدا های سایشی می باشند. این گونه صداها از طریق نزدیک شدن مجرا های تولید صدا در دهان تولید می شوند. این صدا های سایشی در ادای حروف “ف”، “س”، “و” و “ز” ایجاد می شوند. در ادای صداهای این چنینی هوش مصنوعی مشکل دارد و آنها را از نویز نمی تواند متمایز کند. هوش مصنوعی خوشبختانه از انسان سازنده ی صدا درکی ندارد و همه رفتار های گفتاری او را نمی تواند کپی کند.

برای مقابله با مقاصد سو استفاده گرایانه ی دیپ فیک صوتی، شرکت های توسعه دهنده ابزار صدای مصنوعی اقداماتی را انجام می دهند. به عنوان نمونه شرکت Resemble AI در گیت هاب ابزاری به نام Resemblyzer به صورت متن باز قرار داده که می تواند صدا های ساختگی را به طور دقیق شناسایی کند.

هوشیاری و حفظ امنیت خود

فناوری دیپ فیک صوتی روز به روز در حال پیشرفت است و همه ی ما ممکن است روزی به دام افراد سواستفاده گر که از این فناوری استفاده می کنند بیفتیم. در حقیقت باید دانست که فقط افراد مشهور و مدیران بانک قربانی مجرمان سایبری نیستند و هر کسی ممکن است مورد هدف آنها قرار بگیرد. بنابر گفته ی متخصصان امنیتی، سرقت صدای کاربران عادی به تازگی درحال افزایش است.

اگر به هشدار های امنیتی دقت دارید باید این اطمینان را بدهیم که جای نگرانی برای افتادن به دام دیپ فیک صوتی وجود ندارد. همچنین ابزار های موجود، دارای قدرت بالایی در شناسایی صدای مصنوعی هستند.

از آنجایی که هر لحظه ممکن است ابزار هایی ساده که امکان تغییر صدا را به همهی کاربران میدهند منتشر شوند و توسعه پیدا کنند، مردم باید هوشیاری خود را در استفاده از این ابزار ها بالا ببرند. از طرفی دیگر باید دانست که شرکت های امنیتی هم سر جای خود ننشسته اند و در حال تلاش برای بهبود ابزار های شناسایی دیپ فیک صوتی می باشند.